Executive Summary

KI-Agenten und Agentische KI sind keine Synonyme – und diese Verwechslung kostet Unternehmen echtes Geld. Auch wenn die branchenweite Definition noch diskutiert wird, beschreiben wir bei Cloudflight einen KI-Agenten als Softwarekomponente, die für eine spezifische, klar definierte Aufgabe konzipiert ist. Agentische KI hingegen beschreibt eine umfassendere Systemarchitektur mit der Fähigkeit zur autonomen Zielsetzung und mehrstufigen Planung, die in selbstgesteuertem Handeln resultiert.

Die Unterscheidung ist heute wichtiger denn je. Gartner prognostiziert, dass über 40% der Agentische-KI-Projekte bis Ende 2027 eingestellt werden – hauptsächlich, weil Unternehmen nicht wirklich verstehen, was sie kaufen.

Wichtige Fakten:

- KI-Agenten sind aufgabenspezifische Komponenten; Agentische KI ist die Orchestrierungsarchitektur, die sie zum Einsatz bringt.

- 2025 enthielten weniger als 5% der Unternehmensanwendungen aufgabenspezifische KI-Agenten. Für 2026 erwartet Gartner, dass diese Zahl auf 40% steigt.

- 23% der Unternehmen skalieren bereits agentische Systeme; die meisten tun dies jedoch nur in ein oder zwei Geschäftsbereichen.

- Gartner warnt explizit vor „Agent Washing“ – also dem Umetikettieren von Chatbots und RPA-Tools (Robotic Process Automation) zu KI-Agenten – als Hauptursache gescheiterter Projekte.

Fazit: Die korrekte Terminologie ist Voraussetzung für kluge Technologieinvestitionen.

Warum diese Begriffe so verwirrend sind

Die Begriffe wurden zur gleichen Zeit eingeführt und entwickelten sich seitdem öffentlich weiter. Andrew Ng popularisierte das Wort „agentisch“ in einer Vorlesung 2024 – genau zu dem Zeitpunkt, als große Sprachmodelle leistungsfähig genug wurden, um Unternehmen über einfache generative Aufgaben hinaus zu unterstützen. Anbieter beeilten sich, das Wort „Agent“ an jedes Produkt ihres Katalogs zu heften. Anfang 2025 enthielt das durchschnittliche Enterprise-KI-Pitch-Deck beide Begriffe – oft austauschbar.

Diese sprachliche Kollision hat reale Konsequenzen. Gartner-Analysten beschreiben die meisten aktuellen Agentische-KI-Projekte als frühphasige Experimente oder Proof-of-Concepts, die hauptsächlich vom Hype getrieben und oft falsch angewendet werden. Unternehmen erwarten von einem einzelnen Automatisierungstool, dass es komplexe, abteilungsübergreifende Probleme löst, für die es nie konzipiert wurde. Das führt zu zusammenhanglosen Automatisierungen mit inkonsistenter Logik und häufigen Budgetüberschreitungen.

Glücklicherweise benötigen Sie kein Informatikstudium, um die grundlegenden Unterschiede zwischen beiden Begriffen zu verstehen. Es genügt, zwei verschiedene Konzepte zu verstehen: was eine Entität tut versus welche Fähigkeit ein System besitzt.

Was ist ein KI-Agent – und was nicht

Formal betrachtet ist ein KI-Agent ein computergestütztes System, das Beobachtungen einer Umgebung gemäß einer zielgerichteten Strategie, die von seinem Entwickler oder seinem Trainingsprozess definiert wurde, in Aktionen umsetzt. Das klingt kompliziert, also formulieren wir es alltagstauglicher: Es handelt sich um Software, die Eingaben aus ihrer Umgebung wahrnimmt, darüber nachdenkt und auf ein definiertes Ziel ausgerichtet handelt. Das entscheidende Wort ist „definiert“. Jemand hat festgelegt, was dieser Agent tun soll, und der Agent handelt innerhalb dieser Parameter.

Die natürlichen Grenzen von KI-Agenten

KI-Agenten operieren innerhalb expliziter Grenzen, die durch ihr Design und ihre Berechtigungen festgelegt sind. Ein Kundenservice-Agent kann beispielsweise:

- die Bestellhistorie einsehen,

- Rückerstattungen bearbeiten,

- Tickets weiterleiten.

Er kann nicht eigenständig den gesamten Support-Workflow umgestalten, nur weil er ein Muster bei Beschwerden erkannt hat. Diese Entscheidung liegt außerhalb seines Zuständigkeitsbereichs.

Das macht Agenten nicht schwach oder begrenzt im negativen Sinne. Ein gut designter Agent für die Rechnungsprüfung kann außerordentlich zuverlässig sein – gerade weil sein Aufgabenbereich eng gefasst ist.

Ein begrenzter Aufgabenbereich reduziert das Risiko, in übliche KI-Fälle zu tappen, erheblich. Ein KI-Agent improvisiert nicht und halluziniert keine Anweisungen. Er entscheidet nicht eigenständig, ob er auch die Lieferanten-Onboarding-Prozesse übernehmen sollte, nur weil das irgendwie verwandt erscheint.

Was heute tatsächlich als KI-Agent gilt

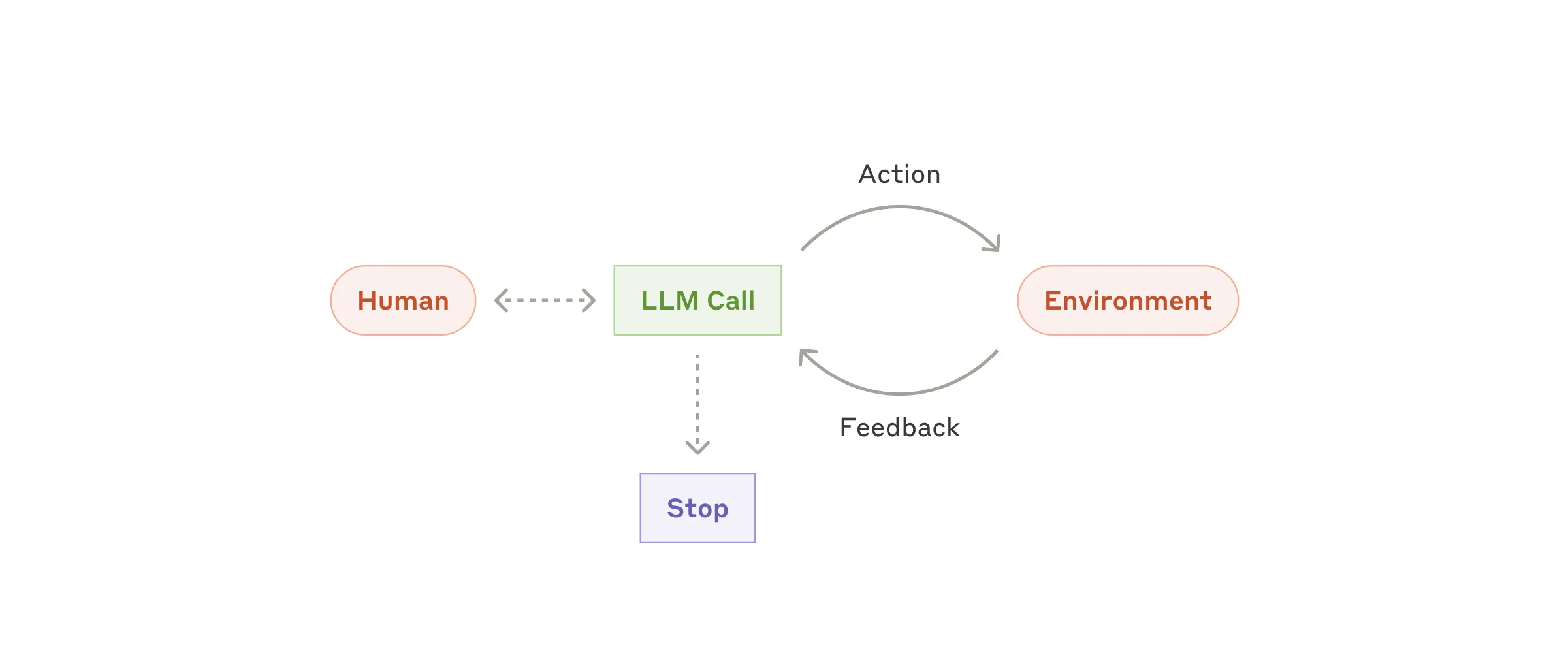

Die Kategorie ist breiter, als viele annehmen. Laut Anthropics Leitfaden zum Bau effektiver Agenten ist ein Agent ein System, „bei dem LLMs dynamisch ihre eigenen Prozesse und Nutzung von Werkzeugen steuern und die Kontrolle darüber behalten, wie sie Aufgaben erledigen.“ Das unterscheidet sich von einem LLM, das einfach einem vordefinierten Skript folgt.

Bildquelle: Anthropic

Praktische Beispiele für echte KI-Agenten sind etwa ein Terminplanungsassistent, der die Kalenderverfügbarkeit prüft, Konflikte löst und Alternativen vorschlägt, oder ein Code-Review-Agent, der einen Pull Request liest, Verstöße gegen den Styleguide identifiziert und diese als Kommentare auflistet. Beide nehmen eine Umgebung wahr, um zu urteilen und zu handeln. Beide sind allerdings auch durch ihren Designrahmen begrenzt.

Was hingegen nicht als KI-Agent gilt, ist beispielsweise ein traditioneller Chatbot, der aus einem Menü vorgefertigter Antworten auswählt. Auch ein Formularausfüllmakro zählt nicht dazu – denn es denkt nicht nach. Gefährlicherweise werden genau diese Systeme in Verkaufsgesprächen häufig als KI-Agenten umetikettiert.